¿Por qué hablar de IA en la escuela del futuro? En un momento en que la inteligencia artificial (IA) ocupa titulares, aparece en las aulas a través de los celulares de estudiantes y se presenta como una promesa de soluciones rápidas y mágicas, resulta necesario preguntarnos qué lugar debe tener en la educación. Pensar la IA en la escuela del futuro no significa solo aprender a usar aplicaciones, sino también problematizar las lógicas de su desarrollo y sus impactos sociales, políticos, económicos y ambientales.

Las y los estudiantes atraviesan una etapa clave de aprendizaje y formación y, al mismo tiempo, son consumidoras y consumidores activos de aplicaciones, juegos y programas que influyen en sus decisiones y hábitos. Por eso, es fundamental democratizar el entendimiento de cómo funcionan los dispositivos computacionales en contextos educativos formales. Comprender los mecanismos detrás de la tecnología permitirá que las y los estudiantes se conviertan en usuarias críticas y usuarios críticos, capaces de cuestionar y decidir sobre las herramientas digitales que forman parte de su vida cotidiana.

La escuela se convierte en un espacio privilegiado para interpelar estas promesas, desandar estereotipos y formar estudiantes capaces de pensar, disputar y decidir sobre el uso de la tecnología en sus vidas y comunidades. En esta oportunidad, abordaremos algunas preguntas para analizar y reflexionar sobre el desarrollo y el funcionamiento técnico de las aplicaciones de IA para, luego, pensar su relación con la escuela.

¿Hace cuánto existe realmente la IA?

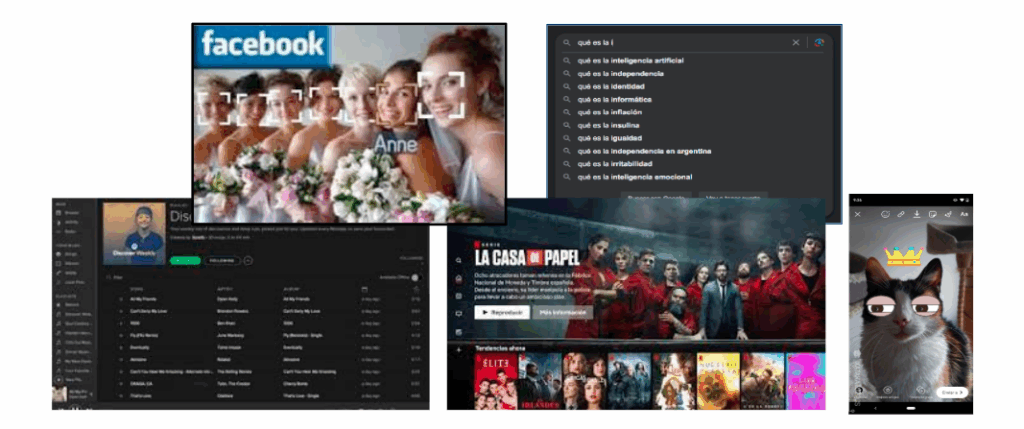

Para empezar, analicemos algunas imágenes entre todas y todos. ¿Qué tienen en común cada una de estas imágenes?

Tenemos la red social Facebook, el buscador de Google, Spotify, Netflix y un filtro de imágenes. Por un lado, todas son aplicaciones que usamos en nuestros celulares o computadoras. Pero hay otra característica que tienen en común. Y es que en todas estas aplicaciones cuentan con funcionalidades que han sido desarrolladas con técnicas que forman parte de la inteligencia artificial: como, por ejemplo, en el caso de Facebook, una de las funcionalidades más utilizadas y conocidas es el etiquetado automático de personas y objetos; también la herramienta que sugiere búsquedas en Google que intenta autocompletar nuestro texto con diferentes opciones; o Spotify y Netflix, cuando nos recomiendan nuevas canciones, series o películas, utilizan sistemas de recomendación desarrolladas con IA.

La IA es una disciplina que tiene más de 70 años de existencia, con épocas donde generó muchas expectativas (sus inicios, los primeros resultados y los desarrollos actuales) y momentos en que su desarrollo e inversión disminuyó (conocidos como “inviernos de la IA”).

Hace más de 20 años que utilizamos aplicaciones cuyas funcionalidades dependen de IA. La IA es una disciplina que tiene más de 70 años de existencia, con épocas donde generó muchas expectativas (sus inicios, los primeros resultados y los desarrollos actuales) y momentos en que su desarrollo e inversión disminuyó (conocidos como “inviernos de la IA”). Cada “invierno” finalizó con avances o desarrollos vinculados directamente con las ciencias de la computación, como el aumento en la capacidad de cómputo y almacenamiento o la aparición de las GPU1Graphics Processing Unit: Unidades de procesamiento gráfico. como infraestructura fundamental del desarrollo de los modelos de IA actuales, o mejoras en las técnicas utilizadas. En ese sentido, no sería posible concebir la IA sin las ciencias de la computación.

¿A qué se debe el éxito actual de la IA?

El éxito actual pertenece a lo que llamamos IA específica y basada en datos. Esta se enfoca en tareas concretas dentro de un dominio particular, como la traducción automática, clasificación de imágenes o generación de texto. Desde inicios del siglo XXI, ha ganado protagonismo y, en la segunda década, alcanzó gran éxito gracias a tres factores: el aumento del poder de cómputo, la expansión del acceso a Internet y la abundancia de datos.

Las aplicaciones actuales de IA se apoyan, en su mayoría, en el aprendizaje automático2ML: machine learning.. Este enfoque requiere grandes volúmenes de datos, accesibles gracias a la digitalización masiva. Por ejemplo, Facebook utilizó millones de fotos etiquetadas por usuarias y usuarios para entrenar sus modelos de reconocimiento facial. Pero, además, el avance vino de la mano del hardware, en particular de las GPU. Estas placas, originalmente diseñadas para videojuegos, realizan miles de cálculos en paralelo, ideal para entrenar modelos de IA. Su adopción a partir de 2005 fue clave para reimpulsar el desarrollo de la IA.

En el proceso de desarrollo, el modelo “aprende” analiza grandes volúmenes de datos mediante un proceso llamado entrenamiento. Dado que las respuestas se basan en probabilidades, se las denomina predicciones. Por ejemplo, Facebook, tras analizar fotos etiquetadas, intenta identificar quién aparece en una nueva imagen. Las fotos son los datos de entrenamiento; el patrón aprendido, el modelo; y el nombre sugerido, la predicción. Estas técnicas requieren mucha intervención humana: desde seleccionar y etiquetar datos hasta validar y ajustar los modelos. Las personas participan activamente en todo el ciclo: definición del problema, diseño del modelo y verificación de resultados, ya que toda predicción es una hipótesis probable, pero no necesariamente cierta. Que en la escuela se pueda reconocer cuánto aportan nuestras acciones como consumidoras y consumidores es un asunto que permitirá “abrir la caja negra” y reconocer los modos en que contribuimos a la definición, el diseño y la verificación.

Artificial, pero totalmente material: ¿cuáles son los costos reales de la IA?

Como describimos anteriormente, parte del éxito actual de la IA se debe al acceso a grandes volúmenes de datos y al aumento del poder de cómputo y procesamiento. Los datos son almacenados en dispositivos que forman parte de enormes centros de datos. Y el entrenamiento y uso de los modelos depende de las GPU. Para la fabricación de estos componentes, se utiliza el cobalto, el litio y otros minerales, existentes en cantidad finita y difíciles de obtener. Entre los problemas más significativos que pueden mencionarse al pensar en la infraestructura tecnológica necesaria para entrenar modelos de IA están:

- La disponibilidad de recursos: la extracción de minerales es limitada y depende de factores geológicos y geopolíticos. La concentración de estos recursos en ciertas regiones del mundo puede generar tensiones y dependencia de proveedores específicos, lo que puede afectar la cadena de suministro global.

- El impacto ambiental: la extracción de estos minerales tiene un impacto ambiental significativo. La extracción y el procesamiento de estos materiales pueden causar contaminación del agua, degradación del suelo y problemas de salud en las comunidades locales.

Pero no solo hay consecuencias ambientales en el proceso de producción. En el uso y el entrenamiento, estos modelos consumen mucha energía. Por ejemplo, durante su entrenamiento, Chat GPT-4 usó lo mismo que 15.000 familias argentinas en un año; y durante el uso, ChatGPT-4 consume de energía eléctrica lo mismo que utilizarían 60.000 familias argentinas. Y aunque parezca raro, la infraestructura que permite que estos modelos existan y funcionen consume agua. Imaginen un galpón con 25.000 GPU, un montón de dispositivos de almacenamiento haciendo cálculos a toda velocidad. No hay ventilador que dé abasto para enfriar, por lo tanto, necesitan refrigeración líquida y grandes cantidades de agua.

¿Afecta la diversidad cultural la generación automática de contenido?

Ya se profundizó en las preguntas previas sobre los modos de funcionamiento de la IA basada en datos. Estos sistemas no piensan, ni crean, ni razonan, sino que reproducen, con la mayor probabilidad, características presentes en los datos de entrenamiento que no representan a todas las comunidades por igual y, por lo tanto, la IA generativa produce contenido “a la manera de” aquello que está presente en los conjuntos de datos de entrenamiento. Preguntarse acerca de qué contienen esos conjuntos se vuelve fundamental para hipotetizar qué tipo de contenidos producirán los sistemas de IA basados en ellos y cuáles quedan fuera.

A continuación, compartimos dos tablas de imágenes generadas utilizando IA a través de las herramientas Copilot y Dall-E 3. La primera tabla es clara de identificar: le pedimos al modelo que genere una imagen de una dona (rosquilla). De cierta forma, podemos ver que el modelo generó correctamente la imagen. En el otro caso, ¿qué se imaginan que le pedimos al modelo que genere? ¿Un flan? ¿Un bizcochuelo? ¿Una rosca de pascua? No, nada de eso. Le pedimos que genere una torta frita. ¿Les parece que las imágenes son similares a una torta frita? ¿Por qué pudo generar la dona de forma perfecta y generó imágenes que poco tienen que ver con una torta frita? Los datos que usaron para entrenar estos modelos dejan en claro el motivo. Seguramente, el conjunto de datos contaba con muchísimas imágenes de donas para generar. Pero no sucede lo mismo con las tortas fritas. A pesar de ser algo muy tradicional de nuestra cultura, no forma parte de los conjuntos de datos de entrenamiento de los modelos y, por lo tanto, claramente afecta la diversidad cultural.

¿Cuál tiene que ser el rol de la escuela con respecto a la IA?

La escuela no puede quedarse en enseñar a usar estas herramientas de manera instrumental, como supo ser en los años 90, cuando se enseñaba ofimática sin comprender lo que había detrás. Hoy, más que nunca, necesitamos ayudar a nuestras y nuestros estudiantes a entender qué hay dentro de la “caja negra”: ¿cómo funciona un modelo?, ¿qué datos usa?, ¿quién lo entrena?, ¿a quién beneficia?, ¿qué costos sociales y ambientales tiene? Saber esto no debiera ser un lujo: es parte del derecho a ejercer ciudadanía crítica en un mundo donde la IA tiene cada vez más influencia. Por ello, este artículo retoma algunas preguntas centrales que nos ayudan a comprender qué hay detrás de la IA en su construcción, pero también en su uso.

A esto se suma la intencionalidad de las empresas, que buscan incorporarse al ámbito educativo con “soluciones mágicas”: prompts que resumen textos, que corrigen tareas o que generan planificaciones. Pero, ¿realmente queremos una escuela donde quienes escriban y corrijan sean sistemas de IA? No tenemos aún claridad sobre qué usos son deseables y cuáles no. Lo que sí tenemos es la capacidad de plantear nuestros intereses y exigir límites: decidir a dónde queremos que esté la IA en la educación y a dónde no.

Cada una de las preguntas que fuimos compartiendo durante el texto tenía la intención de analizar partes de esta “caja negra”. Quiénes la desarrollan, cómo se generan estas soluciones que se venden como mágicas e infalibles y cuáles son sus consecuencias ambientales y sociales. También, cómo se da la reproducción de sesgos o estereotipos por parte de herramientas que fueron desarrolladas para otros contextos que terminan generando contenido que no se corresponde a nuestra cultura. Poder reflexionar en el aula sobre su funcionamiento, su impacto y consecuencias es fundamental. Uno de los mayores desafíos es romper con la confianza ciega en las respuestas de estos sistemas. A modo de ejemplo, ¿queremos que nuestras y nuestros estudiantes crean que una torta frita tiene forma de flan? O peor aún, ¿que reproduzcan nociones históricas de nuestra Argentina con la mirada solo de estas empresas?

El sesgo de automatización, esa tendencia a aceptar lo que devuelve una máquina como cierto, debe ser trabajado en el aula, porque difícilmente pueda ser discutido en otro espacio. La escuela es el lugar donde podemos reflexionar sobre estos desarrollos y la importancia de desconfiar y auditar las soluciones y respuestas generadas por estos modelos, ya que, como dato positivo, se han implementado diferentes experiencias en contextos educativos reales que mostraron un fuerte impacto en las percepciones y la confianza de las y los estudiantes en estas soluciones.

Para hacerlo, necesitamos docentes y estudiantes capaces de comprender, cuestionar y auditar estos sistemas. Curricularizar lo referido a la participación computacional puede contribuir a una formación ciudadana integral, que sea consciente de sus implicancias en cuestiones relacionadas con: la ciudadanía, el cuidado del medio ambiente, la diversidad cultural, los sesgos y sus implicancias y el funcionamiento detrás de los sistemas técnicos. Es posible que estos temas se aborden desde los espacios curriculares que se ligan con las ciencias sociales, las ciencias naturales, las humanidades o la propia educación tecnológica. Pero también es necesario abordar los conceptos fundamentales que permiten entender cómo funcionan estos artefactos computacionales, lo cual nos da herramientas para poder ser creadoras y creadores de tecnología. Estos conceptos se desarrollan desde lo disciplinar para que, luego, en los otros espacios, se pueda abordar la participación computacional de manera más profunda.

La escuela del futuro no se trata de adaptarse a las tecnologías que llegan, sino de formar ciudadanías críticas, capaces de disputar sentidos frente a los discursos corporativos; romper con la confianza extrema en las respuestas de los modelos, pero también en cuanto a que son soluciones neutrales.

La escuela del futuro no se trata de adaptarse a las tecnologías que llegan, sino de formar ciudadanías críticas, capaces de disputar sentidos frente a los discursos corporativos; romper con la confianza extrema en las respuestas de los modelos, pero también en cuanto a que son soluciones neutrales. Como bien dice Martínez, “para trabajar y ejercer ciudadanía en ambientes con IA es necesario saber cómo funcionan los sistemas, sus límites y posibilidades”. Tenemos que incorporar estos temas a nuestras prácticas, no como contenido técnico aislado, sino como parte de una mirada crítica y social. Esto implica hablar de datos, algoritmos, infraestructura, pero también de poder, decisiones y consecuencias.

En un mundo donde somos consumidoras y consumidores, comprender el funcionamiento y el por detrás de estos desarrollos nos transforma en usuarias críticas y usuarios críticos. Pero no solo eso, también las y los estudiantes pueden transformarse en futuras creadoras críticas y futuros creadores críticos de soluciones computacionales. Y eso no es para nada menor, sobre todo si esas búsquedas se impulsan desde la escuela y para la sociedad.

(*) Este escrito se basa en un artículo que escribimos junto a colegas de la Fundación Sadosky: “Diez preguntas frecuentes y urgentes sobre Inteligencia Artificial” (2024)

(**) Doctor en Ciencias de la Computación por la FAMAF-UNC. Profesor e investigador en la FAMAF-UNC y consultor en la Fundación Sadosky, donde desarrolla materiales didácticos, propuestas curriculares y cursos de formación. También fue docente en los niveles Primario y Secundario, en espacios vinculados a las ciencias de la computación. Su trabajo articula investigación, práctica docente y políticas educativas orientadas a integrar la enseñanza de las ciencias de la computación en el sistema educativo.

Una propuesta de UEPC para pensar aportes y desafíos sobre el uso de la IA en la educación

La inteligencia artificial (IA) está propiciando innumerables debates y retos en las más diversas prácticas ciudadanas como en las laborales, y el trabajo docente no escapa a esa realidad. Por ello, en el marco de una extensa trayectoria de UEPC impulsando propuestas de formación que permitan abordar las transformaciones sociotécnicas y sus implicancias para la enseñanza, se dispuso elaborar, desde la Secretaría de Educación, un módulo transversal a todos sus cursos, titulado “Educar en tiempos de Inteligencia Artificial”, al que pueden acceder tanto docentes como equipos de dirección y gestión escolar. Además de diseñarlo, Mercedes Arrieta, Candelaria Arrieta y Julia Villafañe –del área de Educación Digital de la Secretaría– fueron las tutoras del módulo.

La propuesta –reconocida con puntaje docente– busca reflexionar y problematizar los sentidos, desafíos, limitaciones y oportunidades de la IA en las prácticas educativas desde una perspectiva de derechos. A través de ella, se aspira a que las educadoras y los educadores encuentren en el sindicato un espacio actualizado y de calidad para reflexionar de manera situada y crítica sobre las implicancias de la IA en su trabajo.

La modalidad de cursado es combinada (presencial y virtual) y el módulo está organizado en tres bloques de contenido. En cada uno de ellos, se elaboró un material multimedial y se seleccionaron recursos en diferentes lenguajes y soportes, con orientaciones para la reflexión y producción con IA para el aula, la enseñanza o la escuela.

En el bloque 1, se abordan algunas preguntas fundamentales, de orden genérico e introductorio: ¿qué es la IA?, ¿qué es la inteligencia artificial generativa (IAg)?, ¿qué es un prompt?; y permite empezar a construir algunas respuestas y problematizar asuntos éticos y políticos. Se exploran conceptos clave como patrón, sesgo y algoritmo, con una especial atención al sesgo algorítmico, que puede replicar prejuicios y generar resultados injustos o discriminatorios.

En el bloque 2, se indaga qué significa hablar de derechos humanos junto con IA y cómo abordar la equidad y la inclusión en tiempos de inteligencia artificial. Se propone abordar la alfabetización digital como derecho inalienable para el ejercicio de la ciudadanía y la democracia y se plantea la necesidad de reflexionar sobre la inclusión digital y promover la integración ética y responsable de la IA en el aula.

Finalmente, en el bloque 3, se exploran herramientas de IA para la enseñanza, analizando sus potencialidades y riesgos. Se reconoce que la integración de herramientas de este tipo abre nuevas posibilidades, pero también plantea riesgos y desafíos y se invita a reflexionar sobre los asuntos éticos del uso de la IA para formar una ciudadanía crítica y creadora de tecnología, no solo consumidoras y consumidores.

Este año, el módulo contó también con una instancia presencial, que fue la conferencia ofrecida por Mariana Ferrareli, acerca del estado de situación de la IA en educación.

Para quienes no participaran de los cursos organizados por la Secretaría de Educación de UEPC, también se ofreció la posibilidad de realizarlo como un curso autónomo.

De esta manera, el gremio convoca e insta a seguir explorando, aprendiendo y construyendo colectivamente principios éticos y políticos para un uso responsable de la IA, asegurando el respeto de los derechos de las y los docentes y estudiantes.

educar en Córdoba | N° 43 | Octubre 2025 | Año XXIV | ISSN 2346-9439

Artículo: Saberes de la IA para una escuela del futuro

Notas